Fireflies.ai est aujourd’hui l’un des assistants IA de réunion les plus utilisés au monde.

Des millions d’utilisateurs. Des centaines de milliers d’entreprises clientes. Une valorisation qui dépasse le milliard de dollars.

Pourtant, à ses débuts, Fireflies ne reposait sur aucune intelligence artificielle.

Pas de modèle. Pas d’automatisation. Pas de technologie avancée.

Juste deux fondateurs… qui prenaient des notes à la main.

Cette histoire, aussi dérangeante qu’instructive, pose une question centrale pour l’écosystème IA actuel :

où s’arrête la validation produit, et où commence le mensonge technologique ?

Fireflies.ai en 2017 : une promesse avant la technologie

Fireflies.ai est fondée en 2017 par Sam Udotong et Krish Ramineni, à San Francisco.

La promesse est simple et ambitieuse :

- un assistant IA rejoint vos réunions,

- écoute les échanges,

- prend des notes,

- et envoie automatiquement un compte rendu.

Aujourd’hui, ce type d’outil est courant.

Mais en 2017, le contexte est très différent :

- pas de LLM,

- pas de reconnaissance vocale fiable à grande échelle,

- pas d’infrastructure prête à l’emploi.

La technologie nécessaire n’existe tout simplement pas.

“Fred from Fireflies” : l’IA qui n’en était pas une

Derrière l’assistant IA baptisé “Fred”, il n’y avait aucune automatisation.

Fred, c’était :

- Sam et Krish,

- prenant des notes manuellement,

- pendant plus de 100 réunions,

- dans le plus grand silence.

Deux fondateurs fauchés, six échecs entrepreneuriaux derrière eux, plus rien à perdre.

Le principe du “fake it until you make it”, poussé à son extrême.

Aujourd’hui, une licorne bien réelle

Le contraste est brutal.

Fireflies.ai, aujourd’hui, c’est :

- plus de 20 millions d’utilisateurs,

- plus de 500 000 entreprises clientes,

- une valorisation supérieure à 1 milliard de dollars.

Le produit est réel. La technologie existe. L’automatisation est effective.

Mais le chemin pour y arriver interroge profondément.

Fraude ou coup de génie ?

Ce cas divise.

D’un côté :

- accusations de fraude,

- tromperie sur la technologie,

- marketing mensonger.

De l’autre :

- admiration pour la résilience,

- validation intelligente d’un besoin,

- exécution progressive.

La réalité est plus inconfortable.

👉 Oui, Fireflies a menti sur la technologie.

👉 Non, Fireflies n’a pas menti sur le problème à résoudre.

Et c’est précisément là que le débat devient intéressant.

Validation produit vs mensonge technologique

Valider un usage avant d’investir massivement dans la technologie est une pratique saine.

Tester un besoin réel évite de construire une usine à gaz inutile.

Mais vendre une IA inexistante, même temporairement, pose une vraie question éthique.

Les fondateurs affirment que leurs premiers clients étaient des proches, conscients qu’un humain était dans la boucle.

Peut-être. Peut-être pas.

Ce flou est révélateur d’un problème plus large.

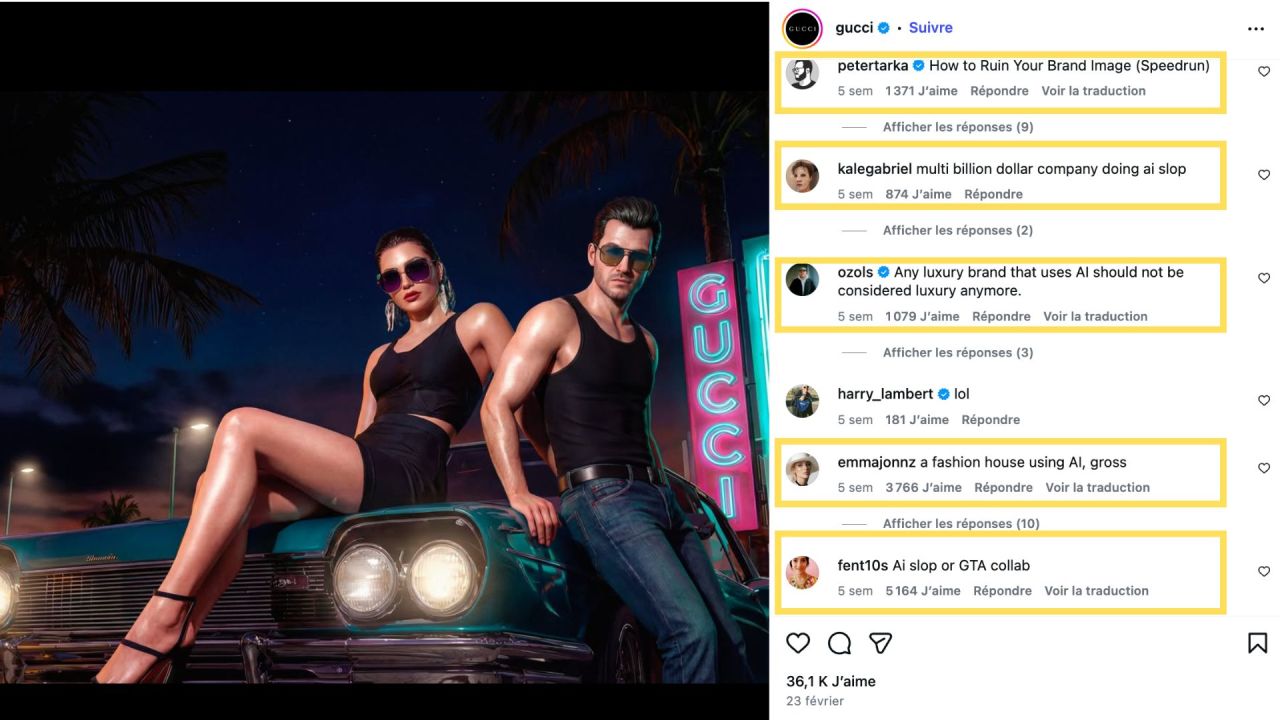

Un miroir tendu à l’écosystème IA actuel

Soyons honnêtes. Combien de startups “IA” aujourd’hui :

- vendent une techno encore inexistante ?

- collent le mot IA sur un script, un process manuel ou un Google Sheet ?

- automatisent plus tard ce qu’elles vendent aujourd’hui ?

Fireflies n’est pas une exception.

C’est un cas visible d’une pratique largement répandue.

La différence majeure :

- Fireflies a fini par construire un vrai produit,

- et cette phase “fake” leur a évité un septième échec.

“Validation before automation”

Sam Udotong résume lui-même l’approche :

“Validation before automation saved us from our 7th failure.”

Cette phrase est clé. Elle dit tout.

Fireflies a d’abord validé :

- que les gens voulaient un résumé automatique,

- qu’ils acceptaient un tiers dans leurs réunions,

- que la valeur perçue était suffisante.

La technologie est venue ensuite.

Une ligne rouge difficile à tracer

Ce cas soulève une question fondamentale pour les marques et les startups IA :

👉 jusqu’où peut-on aller avant de basculer dans l’IA washing ?

- Valider un besoin avec de l’humain dans la boucle est légitime.

- Présenter cet humain comme une IA autonome est dangereux.

La frontière est mince. Et le risque réputationnel, énorme.

Ce que Fireflies nous apprend vraiment

Ce cas n’est ni un modèle à glorifier, ni un scandale à condamner aveuglément.

Il révèle surtout que :

- l’IA n’est pas une solution magique,

- la valeur ne vient pas de la techno seule,

- l’usage précède souvent l’automatisation.

Mais il rappelle aussi une vérité essentielle : la confiance est un actif fragile.

Une startup peut survivre à un produit imparfait. Beaucoup moins à une perte de crédibilité.

Conclusion

Fireflies.ai est devenu une licorne malgré des débuts technologiquement trompeurs.

Pas grâce à l’IA. Grâce à une compréhension fine d’un besoin réel.

Ce succès pose une question que tout acteur de l’IA devrait se poser :

est-ce que je vends une promesse technologique, ou une valeur d’usage ?

La réponse détermine souvent la frontière entre innovation intelligente… et dérive dangereuse.

.png)